WWDC 2024: Apple ist im KI-Zeitalter angekommen

Wo bleibt denn das Thema KI bei Apple? Wann zeigt Apple entsprechende Funktionen? Und was ist eigentlich mit Siri? Diese und ähnliche Fragen ließ der Konzern lange Zeit unbeantwortet – den Begriff Artifical Intelligence (AI) sparrte man einige Zeit sogar ganz bei Präsentationen aus, sprach viel lieber von Machine Learning. Mit der Eröffnungs-Keynote der hauseigenen Entwicklungskonferenz räumt Apple am Montagabend aber fast alle Fragen zu diesem Themenbereich aus und kommt im KI-Zeitalter an. Oder auch: Schließt zu Google und Meta auf. Muss dafür aber auch einen Schritt gehen, der eigentlich so gar nicht zu Apple passt.

Empfehlungen der Redaktion

Artikel wechseln

Keynote in zwei Teilen

In der ersten Stunde der Präsentation war erst einmal kaum etwas von KI zu sehen. Stattdessen drehte sich erst einmal alles um die neuen Betriebssysteme iOS und iPadOS 18, watchOS 11 und visionOS 2. Immer mal wieder blitzte zwar bei der Vorstellung der einzelnen Funktionen auch eine auf, die nur durch KI-Modelle möglich ist. Zum Beispiel, dass die Notizen- oder die Mail-App jetzt auch Zusammenfassungen von Texten für einen schreiben kann.

Oder auch die neue Taschenrechner-App für das iPad, die an sich schon fast eine kleine Sensation darstellt, da sie 14 Jahre nach der Präsentation des erstens iPads endlich ihren Weg auf das Tablet gefunden hat (im Publikum im Apple Park brannte tatsächlich Applaus auf, als die App vorgestellt wurde). Die App kann dank KI nun auch handschriftliche Matheaufgaben lösen und Grafen darstellen – was nicht nur für Schulklassen spannend sein könnte.

Aber wirklich groß um das Thema KI ging es in der ersten Stunde nicht. Bis nach knapp 60 Minuten Apples Software-Chef Craig Federighi noch einmal die Bühne betrat und den zweiten Teil der Keynote eröffnete. Und dieser stand ganz unter einem Begriff: Apple Intelligence. Bestimmt nur ein Zufall, dass die Abkürzung AI lautet.

Apple Intelligence statt Artificial Intelligence

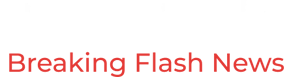

Und in diesem zweiten Teil räumte Apple dann beim Thema KI einmal kräftig auf. Apple Intelligence klingt nach einem Geheimdienst, vereint aber verschiedensten Dinge, die durch unterschiedliche KI-Modelle möglich sind. Mit dabei sind Klassiker wie Large-Language-Modells, die einem beim Verfassen einer Mail helfen können und zum Beispiel den Tonfall einer Nachricht verändern – falls gewünscht.

Auf Wunsch verändert eine Sprach-KI den Tonfall einer Mail oder fasst empfangene Mails zusammen (Bild: Apple)

Oder eine Bild-KI, die individuelle Emoticons erstellt oder den leeren Raum in einer Notiz mit einem Bild füllen kann, das zum Inhalt rund herum passt. Natürlich kann man in iOS 18 und Co. ab Herbst auch Dinge aus Fotos herausretuschieren.

Aber Apple wäre nicht Apple, wenn man den Fokus der eigenen KI-Strategie nicht nur auf solche Funktionen legt, die ehrlicherweise bei anderen Firmen schon länger im Einsatz sind. Stattdessen dreht sich ganz viel um die Themen Sicherheit und Privatsphäre.

Apple verspricht, dass viele der Funktionen auf den Geräten stattfinden und diese gar nicht erst verlassen. Die Bild-KI arbeitet zum Beispiel großteils lokal. Sollte eine Aufgabe doch einmal ein größeres Modell erfordern, dann soll die Bearbeitung auf besonderen Servern passieren, die verschlüsselt sind und die auch nur die Daten erhalten, die für die KI-Funktion nötig sind. Und gespeichert wird auch nichts, verspricht Apple.

Siri und ChatGPT

Und auch Siri fällt neuerdings unter die Kategorie Apple Intelligence und bekommt endlich ihr lange überfälliges Update. Siri wird in naher Zukunft vor allem eines: Ein persönlicher Assistent, der die Informationen in den Apple-Apps, wie Mail, Notizen oder Kalender, verknüpft und entsprechende Anfragen beantworten kann. Eigentlich genau die Version von Siri, die man sich schon lange wünscht. Und auch die sprachlichen Fähigkeiten von Siri wachsen – unter anderem dank einer Kooperation mit ChatGPT.

Das spannende an der Integration der LLMs von OpenAI: Siri selbst schlägt bei unterschiedlichen Anfragen kontextabhängig vor, dass ChatGPT vielleicht eine bessere Antwort liefern könnte und fragt, ob man mit dem Dienst weitermachen möchte. Als Nutzer:in erkennt man so jederzeit, falls Informationen den Apple-Kosmos verlassen. Einen Account bei OpenAI benötigt man als Apple-Nutzer:in nicht, wer möchte kann aber einen Pro-Account von ChatGPT verknüpfen und so auch auf Bezahlversionen zugreifen. Craig Federighi versprach übrigens auch, dass in der Zukunft weitere KI-Modelle anderer Anbieter folgen sollen – es bleibt also nicht bei OpenAI.

Apple ist im KI-Zeitalter angekommen, muss sich dafür aber öffnen

Enttäuschungen gab es natürlich auch. Die neuen KI-Funktionen laufen lokal nur auf Macs und iPads mit den M-Chips, beim iPhone sogar nur mit dem neuen A17 Pro-Chip, also nur auf dem iPhone 15 Pro. Nicht auf dem noch frischen iPhone 15 und auch nicht auf älteren Geräten. Und Siri spricht auch zunächst nur Englisch und viele KI-Funktionen kommen erst „later this year“.

Apple ist aber endlich im KI-Zeitalter angekommen und geht künstliche Intelligenz mit der typischen Apple-Brille an. Der Fokus liegt auf Datenschutz und Funktionen, weniger auf der Größe von Modellen oder einer Siri die flirten kann. Spannend dabei und eigentlich so gar nicht Apple: Die Offenheit gegenüber anderen KI-Modellen und Anbietern. Mit ChatGPT geht es los, aber weitere können und sollen ja auch folgen. Diese Offenheit ist gleichzeitig auch ein Symbol, zeigt sie doch, dass Apple sich öffnen muss, um beim Thema KI mithalten zu können.

Verpasse keine News zu Software & Entwicklung ????

Bitte gib eine gültige E-Mail-Adresse ein.

Es gab leider ein Problem beim Absenden des Formulars. Bitte versuche es erneut.

Bitte gib eine gültige E-Mail-Adresse ein.

Hinweis zum Newsletter & Datenschutz